L'ère du déploiement continu s'étend au-delà du cloud

Imaginez devoir mettre à jour la configuration réseau et les algorithmes de traitement de cinq mille capteurs thermiques répartis dans des dizaines d'entrepôts industriels à travers l'Europe, et ce, en une seule nuit sans la moindre interruption de service. Autrefois, cette tâche relevait du cauchemar logistique, nécessitant des scripts fragiles, des connexions manuelles incertaines et une dose d'espoir non négligeable. Aujourd'hui, la frontière entre l'infrastructure logicielle pure et le matériel physique s'estompe radicalement grâce à l'évolution des pratiques d'ingénierie modernes.

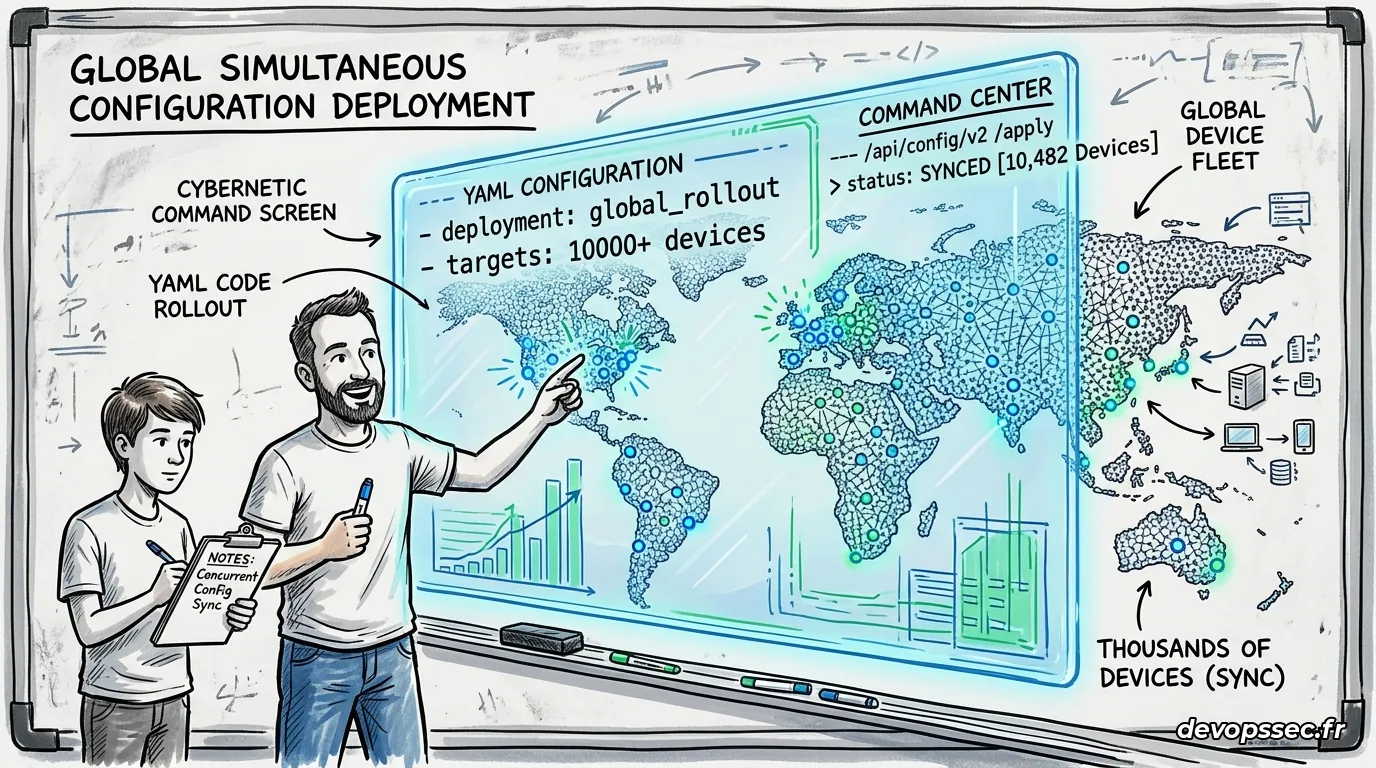

Nous assistons à une véritable révolution où le Déploiement Continu, traditionnellement réservé aux applications web et aux microservices hébergés dans des datacenters confortables, s'exporte directement sur le terrain. L'objectif est d'appliquer les mêmes standards de rigueur, de traçabilité et d'automatisation à des flottes de terminaux distants. En transformant chaque appareil en un nœud d'exécution autonome capable de lire son état désiré depuis un point central, nous redéfinissons la gestion de parc informatique.

C'est ici qu'intervient la philosophie GitOps, une méthode opérationnelle qui utilise un système de contrôle de version comme unique source de vérité pour les infrastructures et les applications. En couplant cette approche avec des outils de synchronisation déclarative, il devient possible de traiter une flotte de Raspberry Pi, de routeurs industriels ou de caméras connectées exactement comme on traiterait un cluster de conteneurs dans le cloud. Le code devient la loi, et le matériel se plie instantanément à ses directives.

La fusion architecturale entre contrôle central et exécution locale

Pour piloter efficacement une multitude d'appareils physiques dispersés géographiquement, il est impératif de repenser l'architecture réseau traditionnelle. Le paradigme de l'Edge Computing consiste à rapprocher la puissance de calcul et le traitement des données au plus près de leur source de génération. Concrètement, au lieu de remonter toutes les informations brutes vers un serveur centralisé, chaque terminal local effectue le premier niveau de traitement et héberge sa propre logique applicative.

Pour que cette décentralisation fonctionne sans devenir un gouffre opérationnel, nous avons besoin d'un orchestrateur capable d'unifier ces terminaux disparates. C'est pourquoi l'intégration de Kubernetes dans ses versions allégées, telles que k3s ou MicroK8s, devient la norme pour le matériel Edge. Ces distributions minimalistes transforment n'importe quel boîtier disposant d'un processeur ARM et d'un peu de mémoire en un nœud fonctionnel, prêt à recevoir des conteneurs standardisés.

Pourtant, déployer manuellement sur des milliers de nœuds k3s indépendants reste irréaliste. La solution réside dans l'inversion du flux de contrôle. Contrairement à un déploiement classique où le serveur CI/CD pousse agressivement les modifications vers les serveurs de production, les nœuds Edge vont eux-mêmes scruter en permanence un référentiel Git pour vérifier si leur configuration actuelle correspond à la configuration déclarée. Ce mécanisme de réconciliation continue garantit une robustesse exceptionnelle face aux coupures réseau.

L'orchestration déclarative en action

Pour visualiser ce ballet technique, il faut comprendre le rôle critique du contrôleur de synchronisation. ArgoCD s'impose naturellement dans cet écosystème grâce à son architecture orientée Kubernetes et sa capacité à gérer des milliers de clusters cibles simultanément. Il agit comme un chef d'orchestre silencieux, surveillant les branches de votre dépôt Git et calculant la différence entre l'état souhaité et l'état réel rapporté par le matériel.

Dans ce modèle, chaque terminal IoT est préalablement enregistré dans ArgoCD en tant que cluster de destination. Lorsqu'un ingénieur approuve une modification de configuration dans Git, par exemple le changement du port de communication d'un capteur, l'orchestrateur détecte la mise à jour instantanément. Il ne force pas la connexion vers les appareils, mais prépare le paquet de configuration que les agents locaux, s'exécutant sur chaque boîtier physique, viendront récupérer et appliquer localement.

Par conséquent, l'infrastructure devient totalement auditable. Si un technicien sur le terrain tente de modifier manuellement la configuration réseau d'une machine via une interface locale, l'agent ArgoCD détectera immédiatement une dérive de configuration. En quelques secondes, il écrasera la modification manuelle pour restaurer l'état déclaré dans Git, assurant ainsi une cohérence absolue à travers l'ensemble de la flotte matérielle.

Automatisation massive avec les ApplicationSets

La véritable puissance d'ArgoCD pour la gestion de flottes Edge réside dans l'utilisation des générateurs d'ApplicationSets. Créer manuellement un fichier de configuration pour chaque appareil est impensable lorsque l'on gère des milliers d'unités. Le modèle ApplicationSet permet de définir un modèle de base (un template) qui sera dynamiquement instancié pour chaque cluster ou dossier découvert dans le dépôt Git.

Génération dynamique des cibles matérielles

Pour mettre en place cette logique, vous devez structurer votre dépôt Git de manière hiérarchique. Par exemple, organisez vos manifestes Kubernetes dans un répertoire /fleet/devices/ où chaque sous-dossier représente un terminal spécifique. ArgoCD utilisera un générateur de type Git Directory pour parcourir ces dossiers et déployer les configurations correspondantes sur les bons appareils physiques.

Astuce d'architecture de dépôt

Privilégiez une séparation stricte entre votre dépôt contenant le code source de vos applications et le dépôt contenant vos manifestes de configuration d'infrastructure. Cela limite la surface d'attaque et empêche un commit applicatif déclenchant des tests CI de polluer l'historique de l'état de votre flotte Edge.

Voici un exemple concret de définition d'un ApplicationSet exploitant un générateur Git. Ce bloc de code YAML illustre comment demander à ArgoCD de scruter tous les sous-dossiers et de remplacer dynamiquement les variables par les noms des répertoires trouvés, ciblant ainsi précisément le bon cluster matériel.

apiVersion: argoproj.io/v1alpha1

kind: ApplicationSet

metadata:

name: iot-fleet-workloads

namespace: argocd

spec:

generators:

- git:

repoURL: https://github.com/votre-org/iot-config-repo.git

revision: HEAD

directories:

- path: fleet/devices/*

template:

metadata:

name: '{{path.basename}}-workload'

spec:

project: default

source:

repoURL: https://github.com/votre-org/iot-config-repo.git

targetRevision: HEAD

path: '{{path}}'

destination:

server: 'https://{{path.basename}}.edge.internal:6443'

namespace: sensors

syncPolicy:

automated:

prune: true

selfHeal: trueUne fois ce manifeste défini, il suffit de l'appliquer sur votre cluster de contrôle central. L'utilisation de l'outil en ligne de commande standard de Kubernetes permet de soumettre cette configuration. Entrez simplement la commande kubectl apply -f applicationset-fleet.yaml dans votre terminal pour déclencher la création massive des applications individuelles.

kubectl apply -f applicationset-fleet.yamlRésultat:

applicationset.argoproj.io/iot-fleet-workloads created

INFO: Successfully generated 5000 Applications from fleet/devices/*

INFO: Synchronization triggered across all edge clusters.Dès cet instant, le contrôleur parcourt votre référentiel. S'il découvre un nouveau dossier d'appareil, il crée automatiquement l'entité de synchronisation associée. Non seulement cette approche réduit drastiquement les erreurs humaines, mais elle documente parfaitement l'étendue de votre réseau matériel au sein d'un historique versionné compréhensible par tous les développeurs de l'équipe.

Les défis silencieux et les limites de l'hyper-connectivité matérielle

Si la théorie du GitOps appliquée au matériel semble miraculeuse, la réalité physique impose des contraintes sévères qu'il est indispensable de maîtriser. Contrairement à un serveur hébergé dans un environnement contrôlé, un capteur industriel est soumis aux coupures de courant, aux interférences électromagnétiques et aux défaillances de réseau mobile. Une architecture mal pensée peut rapidement paralyser toute une chaîne de production.

Gérer la déconnexion et protéger la surface d'attaque

Le principal ennemi de la synchronisation continue est la latence et l'instabilité du réseau. Si un appareil est déconnecté au moment où ArgoCD tente de vérifier son état, la réconciliation est repoussée. Il est crucial d'implémenter une stratégie d'Observabilité distribuée. Les logs et les métriques ne doivent pas dépendre d'une connexion permanente mais être mis en cache localement sur l'appareil avant d'être envoyés vers le système central par lots compressés.

Ensuite vient l'enjeu sécuritaire. Placer un nœud Kubernetes dans un entrepôt ou sur un lampadaire public signifie que le matériel peut être physiquement altéré ou volé. L'accès aux API du plan de contrôle depuis ces terminaux doit être strictement encadré par des certificats éphémères et des politiques de révocation instantanées. Les secrets ne doivent jamais être stockés en clair dans Git, nécessitant l'usage de solutions cryptographiques robustes capables d'être déchiffrées uniquement à l'exécution par le matériel cible.

| Vecteur de Risque IoT | Impact Potentiel sur l'Infrastructure | Stratégie de Mitigation GitOps |

|---|---|---|

| Déconnexion prolongée (Air-gap) | Dérive de configuration silencieuse et obsolescence des politiques de sécurité locales. | Maintien de l'état local via la base de données k3s embarquée et reprise automatique par l'agent à la reconnexion. |

| Vol du matériel physique | Extraction des tokens d'accès réseau et compromission latérale du plan de contrôle central. | Chiffrement intégral du disque local et utilisation de contrôles d'accès basés sur l'identité matérielle (TPM). |

| Surcharge de bande passante | Coûts cellulaires explosifs dus au téléchargement répété d'images de conteneurs volumineuses. | Optimisation extrême des images de base (Alpine, Distroless) et mise en cache au niveau du sous-réseau local. |

Il faut également considérer les limites matérielles inhérentes aux appareils Edge. Bien que k3s soit léger, il consomme des cycles CPU et écrit fréquemment sur le disque pour maintenir l'état du cluster. Sur des cartes mémoire SD d'entrée de gamme, cette écriture incessante réduit drastiquement la durée de vie du matériel, provoquant des corruptions de stockage. L'utilisation de volumes montés en RAM ou de disques SSD industriels devient une condition sine qua non pour la stabilité à long terme.

Vers une résilience absolue des flottes connectées

Déporter la logique de déploiement logiciel vers le matériel physique n'est plus une expérimentation audacieuse, c'est une nécessité technique face à l'explosion du nombre d'appareils connectés. L'alliance entre l'écosystème Kubernetes allégé et les moteurs de réconciliation déclarative ouvre la voie à des infrastructures capables de s'auto-réparer, indépendamment de leur position géographique ou de la qualité de leur connexion temporaire.

En adoptant une approche où le dépôt source fait loi, les équipes d'ingénierie brisent enfin les silos historiques entre les développeurs cloud et les techniciens réseau sur le terrain. Chaque modification matérielle devient traçable, réversible et reproductible à l'infini avec un coût d'effort marginal presque nul. C'est la promesse d'une évolutivité organique, où ajouter mille nouveaux appareils à votre réseau prendra exactement le même temps qu'en ajouter un seul.

Maîtriser ces concepts propulse votre architecture dans une dimension où la fiabilité ne dépend plus des interventions humaines nocturnes, mais d'une chorégraphie mathématique et déclarative inébranlable. Prenez le temps d'expérimenter cette mécanique sur quelques machines virtuelles ou nano-ordinateurs locaux. L'apprentissage de ce flux d'automatisation façonnera inévitablement les standards de fiabilité des prochaines décennies industrielles.

Espace commentaire

Écrire un commentaire

Rejoignez la discussion

Vous devez être connecté pour poster un message.

21 commentaires

N'oubliez jamais que sur du matériel physique, la règle d'or est de toujours avoir un plan de secours pour un accès SSH direct en cas de crash de l'agent ArgoCD.

Ne vous enfermez pas trop dans l'automatisation sans porte de sortie physique.

Pour l'OS et k3s, on utilise

System Upgrade Controller. C'est un operator K8s qui gère les upgrades de nœud de manière sécurisée.Comment vous gérez les versions de

k3ssur le parc ? Vous faites des upgrades automatiques via le même pipeline ?C'est une arme à double tranchant. Si tu veux permettre des modifs manuelles temporaires, tu peux désactiver le

selfHealtemporairement via une annotation.Mais idéalement, le technicien doit commit sa correction dans Git, c'est ça le GitOps pur.

Merci pour l'exemple de code YAML. J'ai une question : le

selfHeal: true, c'est pas dangereux si un technicien doit faire un debug rapide sur place ?Pour 10, c'est peut-être overkill, mais tu gagnes en traçabilité. Si tu prévois de scaler plus tard, autant prendre les bonnes habitudes maintenant.

Le jour où t'en as 100, tu seras content d'avoir déjà toute ta stack déclarative.

Je me demande si ça vaut le coup d'utiliser ArgoCD pour seulement 10 terminaux. Ça paraît être une usine à gaz non ?

Ça dépend de la bande passante. Si t'as une connexion stable, Loki est top. Sinon, fais du buffering local avec

fluent-bitet envoie par batchs compressés.Le but est de ne jamais perdre de logs même quand le lien 4G tombe.

Article solide. Vous avez une reco pour l'observabilité ? Promtail + Loki c'est pas un peu lourd pour du Edge ?

SealedSecrets est le plus simple à mettre en place pour de l'IoT déconnecté. Tu encryptes le secret avec la clé publique du cluster, tu commits le résultat chiffré dans Git.

Ça reste indéchiffrable sans la clé privée qui vit sur le nœud Edge.

J'ai un problème avec les secrets. Git n'est pas fait pour ça. Vous utilisez quoi ? SealedSecrets ou Vault ?

Oui, utilise les

nodeSelectorou desaffinitydans tes manifests. L'ApplicationSet lui-même déploie partout, mais c'est le scheduler Kubernetes qui gère le placement selon les labels du nœud physique.Est-ce que c'est possible de mettre des conditions dans le générateur ? Genre ne pas déployer tel workload sur les vieux terminaux qui n'ont pas assez de RAM ?

C'est là que GitOps brille. Le rollback, c'est juste un

git revertsur ton repo de conf.ArgoCD détecte le changement et synchronise l'état précédent. T'as pas besoin de scripts complexes, juste un commit et ça revient à l'état stable.

J'ai testé le

kubectl apply -f applicationset-fleet.yaml, ça passe crème sur mon lab. Par contre, comment on gère le rollback propre si une config pète un parc entier ?C'est le point noir. Oublie les SD cards grand public. Il faut passer sur du SSD industriel ou, au pire, configurer

k3spour limiter les writes sur/var/lib/rancher/k3s/storage.Passer par des volumes

emptyDirenMemorypour les logs aide beaucoup à prolonger la vie du matos.Attention à l'usure des cartes SD avec

k3s. Vous avez des retours d'expérience sur la durée de vie en production ?Tu peux utiliser des

values.yamlspécifiques par dossier dans ton repofleet/devices/. ArgoCD va mapper ça automatiquement.Tu peux aussi utiliser les paramètres dynamiques du générateur

ApplicationSetpour injecter des variables directement dans tes templates Helm.L'idée de l'ApplicationSet avec

gitdirectory est top. Tu gères comment les variables d'environnement spécifiques à chaque site dans ton repo ?C'est une bonne remarque. Le secret c'est de ne pas laisser chaque nœud tirer l'image depuis le registre central. Utilise un registry miroir ou un proxy local sur chaque site ou sous-réseau.

Avec

k3s, tu peux aussi jouer sur lesImagePullPolicy: IfNotPresentpour éviter de retélécharger à chaque redémarrage du pod.Super article. Par contre, déployer sur 5000 terminaux, ça me fait flipper niveau charge réseau. Comment tu gères le pull simultané des images Docker sans saturer les liens 4G ?