Introduction : Pourquoi le MLOps est devenu incontournable

Vous avez certainement remarqué cette effervescence : l'intelligence artificielle n'est plus un concept futuriste confiné aux laboratoires de recherche, mais une réalité tangible qui s'infuse dans toutes les strates de nos applications. Pourtant, un grand nombre de projets de Machine Learning, aussi brillants soient-ils en phase d'expérimentation dans un notebook Jupyter, n'atteignent jamais la production. C'est précisément ici que le bât blesse.

Le gouffre qui sépare le prototype du Data Scientist et une application résiliente, scalable et maintenable est immense. Ce fossé est culturel, organisationnel et technique. C'est pour le combler qu'est né le MLOps, une discipline qui fusionne les principes du DevOps avec les spécificités du cycle de vie des modèles de Machine Learning.

L'objectif n'est pas simplement de "déployer un modèle", mais de construire une chaîne industrielle complète, automatisée et fiable. Il s'agit de garantir que chaque nouvelle version d'un modèle peut être entraînée, validée, déployée et surveillée avec le même niveau de rigueur et d'efficacité qu'une application logicielle traditionnelle.

Les Fondations du MLOps : Plus qu'un simple CI/CD

Penser que le MLOps se résume à appliquer un pipeline CI/CD classique à un projet de Machine Learning est une erreur commune. La réalité est bien plus complexe, car nous ne gérons pas uniquement du code. Nous devons orchestrer un triptyque fondamental : le code, le modèle et, surtout, les données.

Chacun de ces trois éléments possède son propre cycle de vie, ses propres contraintes de versioning et ses propres impératifs de qualité. C'est cette interdépendance qui rend les pipelines MLOps si uniques et si puissants lorsqu'ils sont bien maîtrisés.

De la Donnée au Modèle : Le Cycle de Vie MLOps

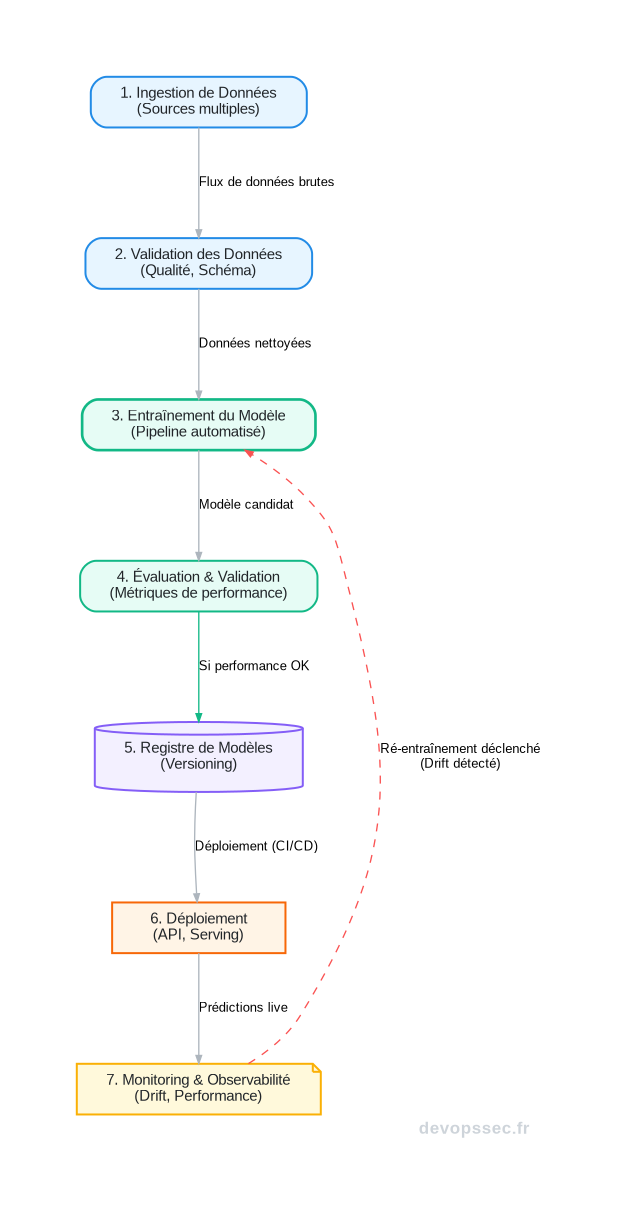

Concrètement, un workflow MLOps est une boucle de rétroaction continue où chaque étape alimente la suivante. Ce n'est pas un processus linéaire qui s'arrête une fois le modèle en production, mais un cycle vivant qui évolue avec les nouvelles données et les nouveaux besoins métiers.

L'automatisation est la clé de voûte de cette architecture. Elle permet de réduire les interventions manuelles, d'accélérer les itérations et de garantir la reproductibilité des expérimentations, un Graal pour tout Data Scientist qui a déjà passé des jours à essayer de retrouver les conditions exactes d'un ancien entraînement.

Les Pièges à Éviter : Au-delà de la Technique

Adopter le MLOps ne se fait pas sans heurts. La complexité de l'outillage, notamment autour d'écosystèmes comme Kubeflow sur Kubernetes, peut représenter une barrière à l'entrée non négligeable. L'infrastructure requise est souvent coûteuse et demande une expertise pointue pour être maintenue en conditions opérationnelles.

De plus, la sécurité prend une nouvelle dimension. Au-delà des vulnérabilités classiques du code, il faut se prémunir contre des attaques spécifiques au Machine Learning, comme l'empoisonnement des données d'entraînement (data poisoning) ou les attaques par inférence qui visent à extraire des informations sensibles à partir des prédictions du modèle.

Le coût humain du MLOps

Ne sous-estimez jamais le besoin de collaboration. Le succès du MLOps repose sur la capacité des Data Scientists, des DevOps et des Software Engineers à parler un langage commun et à travailler sur des objectifs partagés. Sans cette culture, les meilleurs outils du monde resteront inefficaces.

L'Observabilité en MLOps : Surveiller ce qui Compte Vraiment

Si vous avez l'habitude de surveiller des applications web, vous pensez immédiatement à des métriques comme le temps de réponse, le taux d'erreur ou l'utilisation du CPU. En MLOps, ce n'est que la partie émergée de l'iceberg. La véritable complexité réside dans la surveillance du comportement du modèle lui-même, une fois qu'il est confronté aux données du monde réel.

En effet, un modèle de Machine Learning n'est pas statique. Sa performance peut se dégrader silencieusement avec le temps, non pas à cause d'un bug dans le code, mais parce que le monde change. C'est ce phénomène que l'on cherche à détecter avec l'observabilité.

Deux concepts sont absolument fondamentaux à comprendre : le Data Drift et le Concept Drift. Le premier se produit lorsque les nouvelles données en entrée diffèrent statistiquement de celles sur lesquelles le modèle a été entraîné. Le second est plus subtil : la relation entre les entrées et la sortie attendue change, même si les données d'entrée semblent similaires.

Concrètement, un modèle entraîné à prédire des fraudes avant une crise économique pourrait devenir obsolète après, car les comportements des fraudeurs ont évolué. C'est un exemple typique de Concept Drift, et sans une surveillance adéquate, votre modèle produira des prédictions de plus en plus erronées sans jamais lever la moindre alerte système classique.

| Type de Monitoring | Métriques Classiques (DevOps) | Métriques Spécifiques (MLOps) |

|---|---|---|

| Performance Système | Latence de l'API, Utilisation CPU/RAM, Taux d'erreurs 5xx | Latence d'inférence, Débit de prédictions (QPS) |

| Qualité des Données | N/A | Distribution statistique des features, Pourcentage de valeurs nulles, Détection d'anomalies en entrée |

| Performance du Modèle | N/A | Accuracy, Précision, Rappel (si vérité terrain disponible), Score de confiance des prédictions |

| Dérive (Drift) | N/A | Distance statistique (ex: Kolmogorov-Smirnov) entre les données d'entraînement et de production |

Mise en Pratique : Un aperçu du Pipeline

Passons de la théorie à un exemple plus tangible. Pour orchestrer nos workflows, une solution populaire est Kubeflow, qui s'appuie sur Kubernetes pour exécuter chaque étape du pipeline dans un conteneur isolé. Cela garantit la portabilité et la reproductibilité.

Imaginons un composant simple de ce pipeline, chargé de prétraiter des données. Sa définition en YAML ressemblerait à ceci.

name: Preprocess Data

description: Loads raw data and prepares it for training.

inputs:

- {name: raw_data_path, type: String, description: 'Path to the raw CSV file.'}

outputs:

- {name: processed_data_path, type: String, description: 'Path to the processed data.'}

implementation:

container:

image: my-docker-registry/preprocess-image:latest

command: [

python, /app/preprocess.py,

--input-path, {inputValue: raw_data_path},

--output-path, {outputPath: processed_data_path}

]Ce fichier définit clairement les entrées et sorties du composant, ainsi que l'image Docker à exécuter. Les placeholders comme {inputValue: raw_data_path} sont remplacés à l'exécution par l'orchestrateur, ce qui permet de chaîner les étapes de manière dynamique.

Chaque exécution, chaque paramètre et chaque métrique de performance peuvent ensuite être tracés grâce à un outil comme MLflow. Cela crée un historique complet de toutes vos expérimentations, ce qui est crucial pour l'auditabilité et le débogage.

Conclusion : Le MLOps comme Levier Stratégique

Vous l'aurez compris, le MLOps est bien plus qu'une simple collection d'outils ou de scripts d'automatisation. C'est une transformation culturelle profonde qui impose une collaboration sans précédent entre les équipes de Data Science, d'ingénierie logicielle et d'opérations.

En adoptant cette approche, on ne se contente pas de mettre des modèles en production plus rapidement. On construit des systèmes d'IA robustes, évolutifs et, surtout, fiables. On transforme le Machine Learning d'une activité artisanale, proche de la recherche, en une discipline d'ingénierie prédictible et génératrice de valeur pour l'entreprise.

Le chemin est exigeant et demande un apprentissage constant, mais maîtriser ces principes est aujourd'hui un différenciateur majeur pour tout professionnel de la tech qui souhaite construire les applications intelligentes de demain.

Espace commentaire

Écrire un commentaire

Vous devez être connecté pour poster un message !

14 commentaires

révolutionner les pipelines d'ia c'est la mission

on galérait sur le suivi de nos modèles en prod

l'observabilité en mlops c la solution pour nous

L'ère de l'IA demande ces fondations

Ceux qui pensent que c'est juste du déploiement se trompent lourdement

La gestion des modèles c'est un enfer sans MLOps

Développement robuste grâce à ces pratiques

Enfin un article qui relie bien DevOps et IA

Ça manquait pour expliquer le besoin à la direction

MLOps un vrai levier stratégique pour l'innovation agile

L'aperçu du pipeline m'a donné des idées pour le nôtre

Le cycle de vie de la donnée au modèle est complexe

Les pièges à éviter au-delà de la technique c'est super important

Plus qu'un simple CI/CD c'est bien dit

L'Observabilité en MLOps c'est ce qui compte vraiment

Le MLOps est devenu incontournable c'est clair

Nos pipelines CI/CD classiques ne suffisaient plus