L'aube d'une nouvelle ère pour les microservices

Vous avez probablement déjà passé une nuit blanche à cause d'une alerte PagerDuty, déclenchée par un service critique qui s'effondre sans crier gare. Cette situation, emblématique de nos architectures distribuées, révèle une vérité fondamentale : nos systèmes sont devenus incroyablement complexes, mais leur capacité à gérer cette complexité est restée largement manuelle et réactive.

Pourtant, une transformation silencieuse est en cours. Nous passons de la simple orchestration, où Kubernetes redémarre un pod défaillant, à une véritable autonomie, où les services eux-mêmes deviennent des entités intelligentes, capables de se diagnostiquer, de se réparer et même de s'optimiser sans intervention humaine. Bienvenue dans l'ère des microservices autonomes.

Il ne s'agit plus seulement de résilience, mais d'antifragilité. L'objectif n'est plus de survivre à une panne, mais d'en sortir plus fort, en apprenant de chaque incident pour éviter qu'il ne se reproduise. C'est un changement de paradigme complet pour le DevOps.

Les piliers de l'intelligence système

Pour qu'un système devienne autonome, il doit reposer sur des fondations bien plus sophistiquées que les health checks traditionnels. L'autonomie n'est pas une fonctionnalité que l'on active, mais une capacité émergente issue de la synergie de trois piliers fondamentaux.

L'auto-diagnostic : Voir au-delà du symptôme

Un service qui répond avec un code HTTP 200 n'est pas nécessairement en bonne santé. Il peut être lent, consommer une quantité anormale de mémoire, ou avoir une dépendance qui est sur le point de flancher. L'auto-diagnostic consiste pour un service à avoir une conscience profonde de son état interne et de son environnement.

Cette conscience est alimentée par une observabilité de nouvelle génération. On ne se contente plus de collecter des métriques, des logs et des traces de manière passive. On utilise des technologies comme eBPF (Extended Berkeley Packet Filter) pour sonder le comportement du système au niveau du noyau Linux, sans aucune modification du code applicatif.

Cela permet de capturer des signaux de faible intensité, comme une augmentation subtile de la latence réseau ou une contention sur un verrou système, qui sont souvent les précurseurs d'une défaillance majeure. Le système ne se contente pas de savoir qu'il est "malade", il peut identifier précisément la nature de sa pathologie.

L'auto-réparation : L'action corrective intelligente

Une fois le diagnostic posé, le système doit pouvoir agir. L'auto-réparation va bien au-delà du simple redémarrage d'un conteneur. Il s'agit d'un catalogue d'actions contextuelles que le système peut déclencher de manière autonome pour restaurer son état nominal.

Concrètement, ces actions peuvent être très variées et dépendent de la nature du problème identifié. L'intelligence du système réside dans sa capacité à choisir la bonne action au bon moment, en se basant sur les données de l'observabilité et des politiques prédéfinies.

| Symptôme Détecté | Action d'Auto-Réparation Classique | Action d'Auto-Réparation Autonome |

|---|---|---|

| Latence élevée sur une dépendance | Alerte manuelle, ouverture d'un circuit breaker | Déclenchement d'un Circuit Breaker Adaptatif qui déroute le trafic vers un fallback, tout en envoyant des sondes pour détecter la récupération. |

| Fuite de mémoire lente | Redémarrage programmé hors heures de pointe | Déclenchement d'un "canary draining" : une nouvelle instance saine est démarrée, le trafic y est progressivement basculé, puis l'instance défaillante est arrêtée pour analyse. |

| Cache empoisonné (données invalides) | Purge manuelle du cache via une commande | Détection de la source des données invalides via le traçage distribué, purge ciblée de la clé corrompue et mise en quarantaine temporaire de la source de données. |

L'auto-optimisation : Apprendre du passé pour bâtir le futur

C'est le stade ultime de l'autonomie. Le système ne se contente pas de réparer les pannes, il apprend de chaque événement pour améliorer ses performances et sa résilience. Il ajuste ses propres paramètres pour éviter que les problèmes ne se reproduisent.

Par exemple, s'il détecte régulièrement une congestion sur un pool de connexions à la base de données chaque matin à 9h, il peut décider de manière proactive d'augmenter la taille de ce pool à 8h55, puis de la réduire à 10h pour économiser les ressources. Il modifie son propre comportement en fonction des schémas observés.

Cette boucle de rétroaction continue transforme une architecture réactive en un système vivant, qui s'adapte en permanence à son environnement et à sa charge de travail. C'est la promesse de l'AIOps (AI for IT Operations) appliquée au cœur même de l'architecture logicielle.

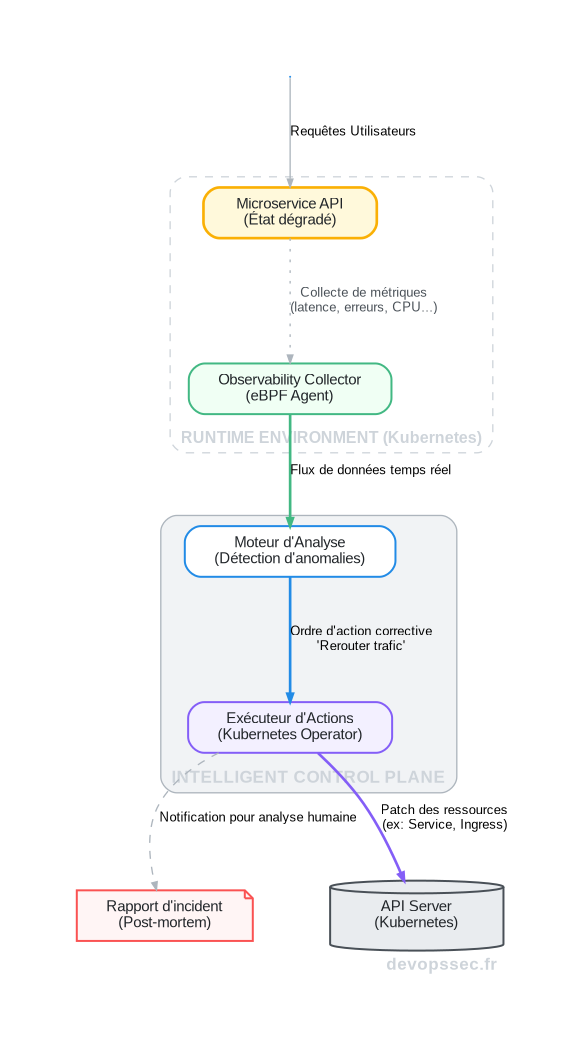

Architecture d'un système Self-Healing

Mettre en place un tel système n'est pas trivial. Cela requiert un couplage fort entre des outils d'observabilité avancés, un plan de contrôle intelligent (souvent un opérateur Kubernetes sur-mesure) et des applications conçues pour être pilotées de l'extérieur.

Le flux d'une action d'auto-réparation illustre bien cette orchestration complexe. Tout commence par la collecte passive de données à très haute granularité, qui est ensuite analysée en temps réel pour détecter des déviations par rapport à un comportement normal.

Le plan de contrôle, qui est le cerveau du système, doit être capable de corréler des signaux provenant de différentes sources pour prendre une décision éclairée. Par exemple, une simple augmentation de la latence n'est pas suffisante. Mais si elle est corrélée à une augmentation des erreurs 503 sur un service en aval et à une pression mémoire sur le pod, l'opérateur peut conclure avec une haute probabilité qu'un redémarrage ciblé est la solution la plus appropriée.

Voici à quoi pourrait ressembler une politique de self-healing, définie via une ressource personnalisée (CRD) dans Kubernetes. Notez comment elle lie un symptôme (un slo) à une série d'actions pondérées.

apiVersion: healing.acme.io/v1alpha1

kind: HealingPolicy

metadata:

name: user-service-latency-policy

spec:

# Cible le déploiement 'user-service'

targetRef:

kind: Deployment

name: user-service

# La condition qui déclenche la politique

trigger:

type: slo

slo:

# Si la latence au 99ème percentile dépasse 500ms pendant 2 minutes

metric: histogram_quantile(0.99, rate(http_requests_latency_seconds_bucket[5m]))

threshold: 0.5 # 500ms

duration: 2m

# Liste des actions à tenter, dans l'ordre

actions:

- name: clear-cache

weight: 80 # Tentative à 80%

command: ["/bin/sh", "-c", "redis-cli flushall"]

cooldown: 5m

- name: rolling-restart

weight: 20 # Tentative à 20% si la première échoue

strategy: canary

maxUnavailable: 1

cooldown: 15mLes angles morts de l'autonomie

L'idée d'un système qui se gère tout seul est séduisante, mais elle n'est pas sans risques. L'autonomie introduit de nouvelles couches de complexité, et comme toute technologie puissante, elle doit être maîtrisée avec précaution.

Le risque de la "boîte noire"

Lorsqu'un système prend des centaines de décisions correctives par jour, comment un ingénieur peut-il comprendre l'état réel de la production ? Si une action autonome provoque une panne en cascade, le débogage peut devenir un cauchemar. Il est crucial que chaque action soit tracée, expliquée et corrélée à l'anomalie qui l'a déclenchée.

L'enjeu de l'"explainability" est central. Nous devons construire des systèmes dont les décisions ne sont pas seulement efficaces, mais aussi compréhensibles par les humains qui en ont la charge. Sans cela, nous risquons de perdre le contrôle et la confiance dans nos propres créations.

Le Dry-Run est votre meilleur ami

Avant de donner à un opérateur le pouvoir de modifier la production, faites-le tourner en mode "dry-run" pendant des semaines. Il analysera les métriques et annoncera les actions qu'il aurait prises. Cela vous permet de valider sa logique et d'ajuster ses seuils sans aucun risque, transformant les logs en un outil d'apprentissage inestimable.

Un changement culturel avant tout

Les systèmes self-healing ne vont pas remplacer les ingénieurs DevOps ou SRE. Au contraire, ils élèvent le niveau de compétence requis. Le travail n'est plus d'éteindre des incendies, mais de devenir l'architecte, le formateur et le gardien de ces systèmes autonomes.

Les compétences requises évoluent : il faut non seulement maîtriser l'infrastructure et le code, mais aussi comprendre l'analyse de données, les modèles statistiques de détection d'anomalies et la théorie du contrôle. C'est un changement profond qui demande un investissement significatif en formation et en R&D.

Conclusion : Vers une infrastructure organique

Nous sommes au début d'un voyage passionnant. Les microservices autonomes représentent la prochaine évolution logique des systèmes distribués. En leur donnant les moyens de percevoir, de raisonner et d'agir, nous ne construisons plus des machines rigides, mais des organismes numériques capables de s'adapter et de survivre dans des environnements chaotiques.

Le rôle de l'ingénieur DevOps de demain ne sera plus celui d'un opérateur, mais celui d'un mentor pour une intelligence artificielle distribuée. Notre mission n'est plus de maintenir les systèmes en vie, mais de leur apprendre à vivre par eux-mêmes. C'est un défi immense, mais la promesse d'une infrastructure véritablement résiliente en vaut la peine.

Espace commentaire

Écrire un commentaire

Vous devez être connecté pour poster un message !

14 commentaires

Les systèmes capables de s'auto-optimiser sont le futur

actif

Performance inégalée avec ces systèmes c'est motivant

actif

On a déjà commencé sur l'auto-diagnostic pour notre plateforme

Cet article valide nos choix technos

actif

Les microservices autonomes ça va devenir la norme

actif

redéfinir les opérations devops c'est exactement le cas

actif

Notre architecture Self-Healing doit s'inspirer de ça

actif

L'auto-optimisation apprend du passé c'est intelligent

Ça aide à réduire la charge sur les humains

actif

L'aube d'une nouvelle ère pour les microservices c'est certain

actif

les piliers de l'intelligence système bien détaillés

actif

Vers une infrastructure organique j'achète

actif

Risque de la "boîte noire" un vrai challenge

actif

Voir au-delà du symptôme pour l'auto-diagnostic c'est bien vu

actif secouriste

Le changement culturel est vraiment un point clé

actif

L'auto-réparation c'est le graal des ops

Top de voir comment on peut y arriver